"为了防止恶意爬虫,手机扫一扫下载"

请使用手机扫一扫上面二维码,或者在在文章末尾获取地址

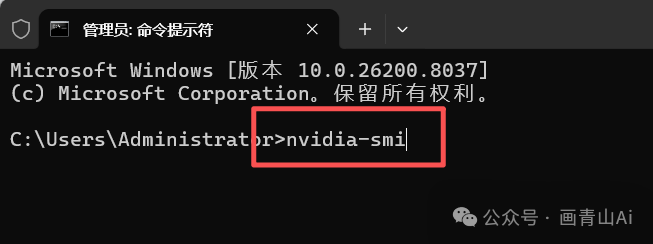

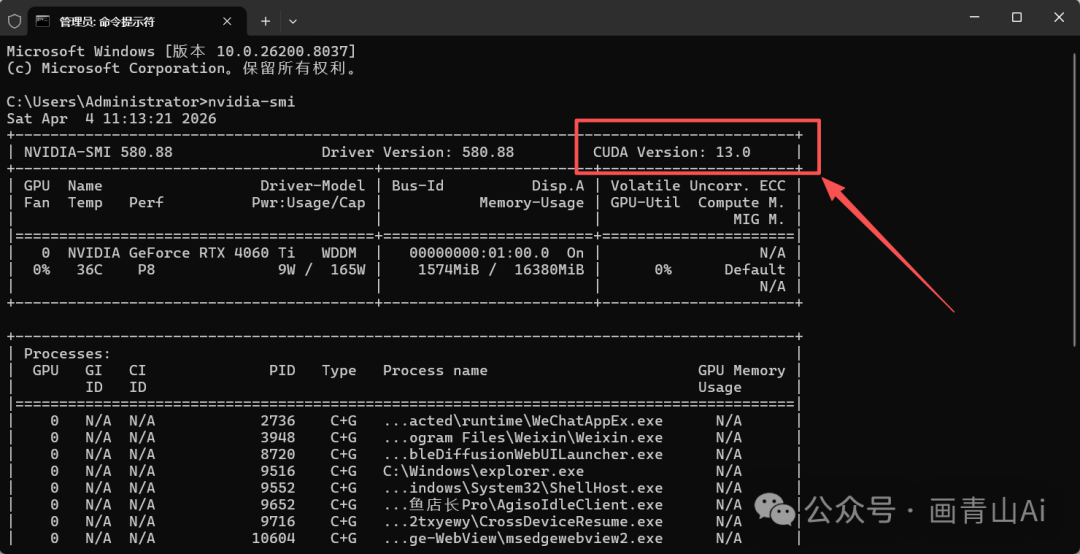

1 显卡驱动cuda版本查询

运行Qwen3.5插件的节点需要的CUDA版本为CUDA13.0,首先要确定自己电脑的显卡驱动(必须是N卡)最高支持的cuda版本。打开命令提示符(CMD),输入命令:nvidia-smi

右上角的CUDA Version 表示你电脑显卡驱动支持的最高 CUDA 版本。

例如我的电脑命令提示符显示为13.0,则代表可安装13.0及以下版本的CUDA Toolkit,此处我们需为电脑安装13.0版本的CUDA

2 comfyUI整合包的CUDA版本

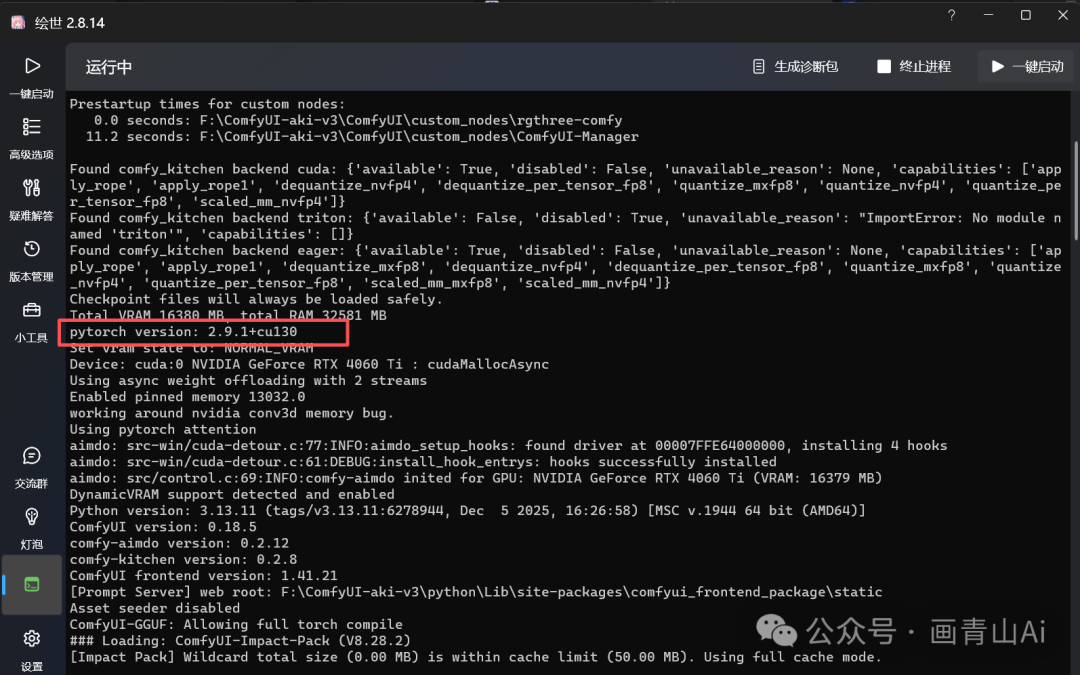

pytorch版本查看方法:开启绘世启动器,运行数据中会显示pytorch版本及cuda版本,比如我直接使用的最新版本绘世启动器自带的pytorch版本是2.9.1,cuda版本是13.0,python版本是3.13.11。

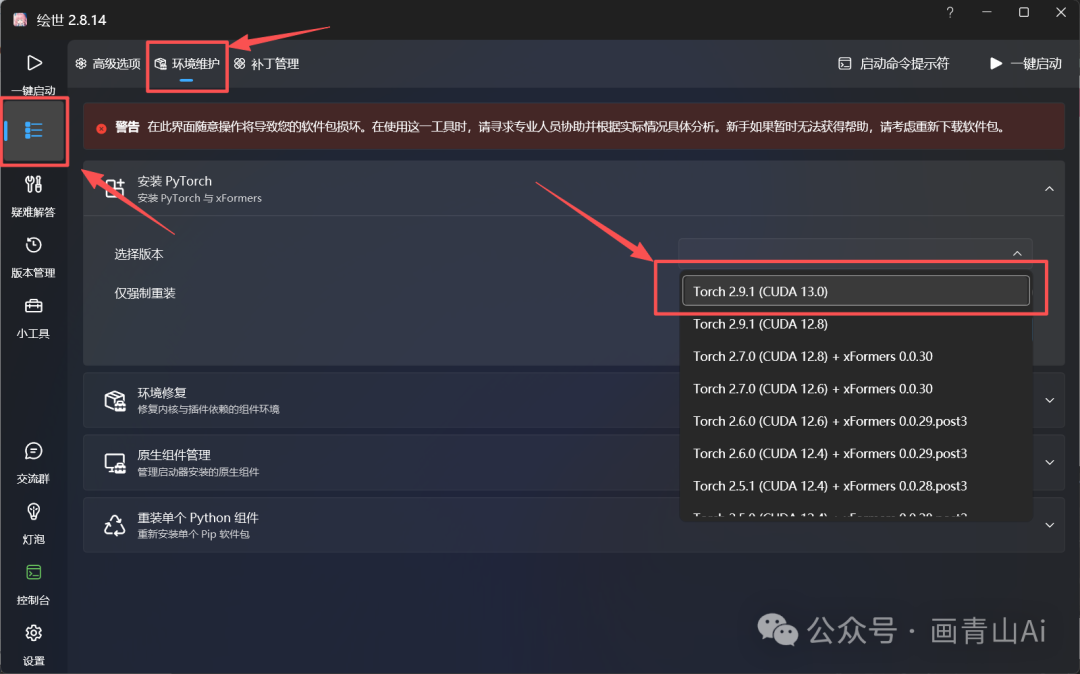

如果你的pytorch版本过低,可以到绘世启动器的“高级选项”界面下“环境维护”页面进行安装,方式如下图所示:

3 llama-cpp插件及轮子安装

3.1 ComfyUI-llama插件

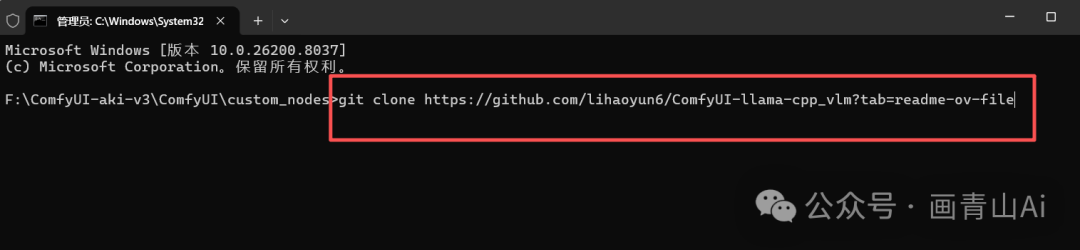

Qwen3.5需要的插件是ComfyUI-llama-cpp_vlm,项目地址为:https://github.com/lihaoyun6/ComfyUI-llama-cpp_vlm?tab=readme-ov-file

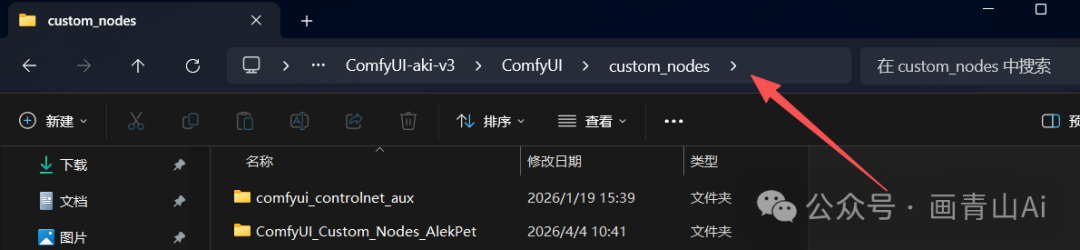

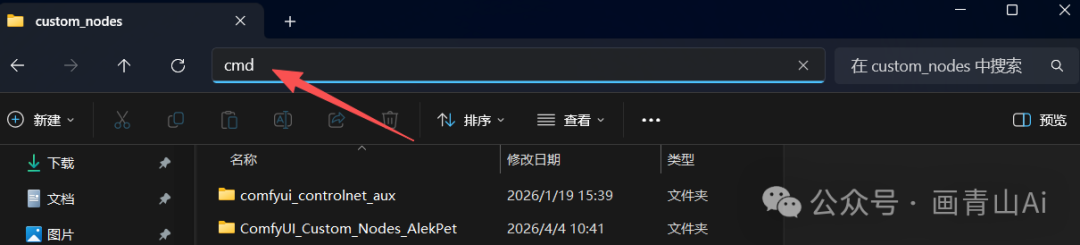

插件安装:在comfyUI的custom_nodes文件夹下使用cmd安装,安装地址为git clone https://github.com/lihaoyun6/ComfyUI-llama-cpp.git

方法二:也可以下载插件文件夹,直接复制黏贴到custom_nodes文件夹中即可。

https://pan.quark.cn/s/bd6a16ad9940

3.2 轮子安装

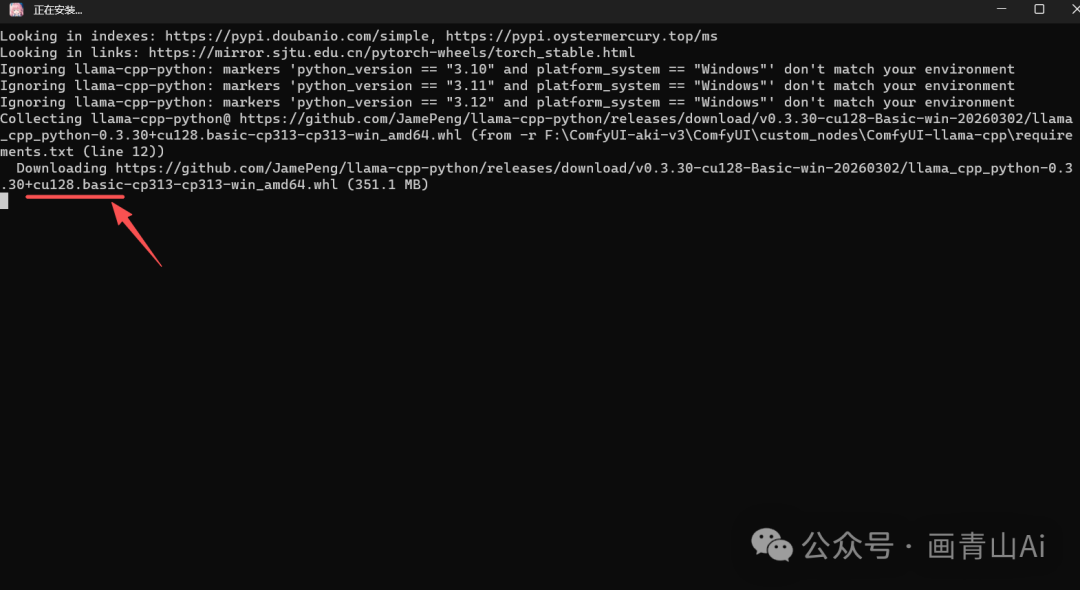

安装ComfyUI-llama-cpp_vlm插件所需要的Python依赖(轮子) 使用秋叶整合包,在/custom_nodes文件夹下使用cmd方式安装依赖,会自动安装cu128版本轮子(见下图),但cuda版本需要的是13.0的并不适配,所以我们不要使用这个方式进行安装。python -m pip install -r ComfyUI-llama-cpp/requirements.txt

下面是正确的方式,我们需要自行下载轮子并安装,轮子地址:

https://github.com/JamePeng/llama-cpp-python/releases

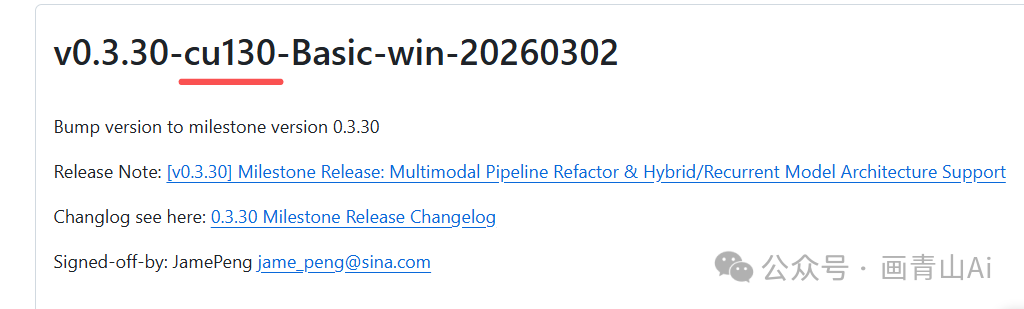

可以看到轮子下载页面下文件版本众多,需要找到与个人电脑环境适配的torch版本及python版本进行下载安装。 前文已经查询过,我使用的绘世启动器pytorch版本是2.9.1,cuda版本是13.0,python版本是3.13.11。所以此处,因为cuda版本是13.0,要找到对应标有cu130的版本

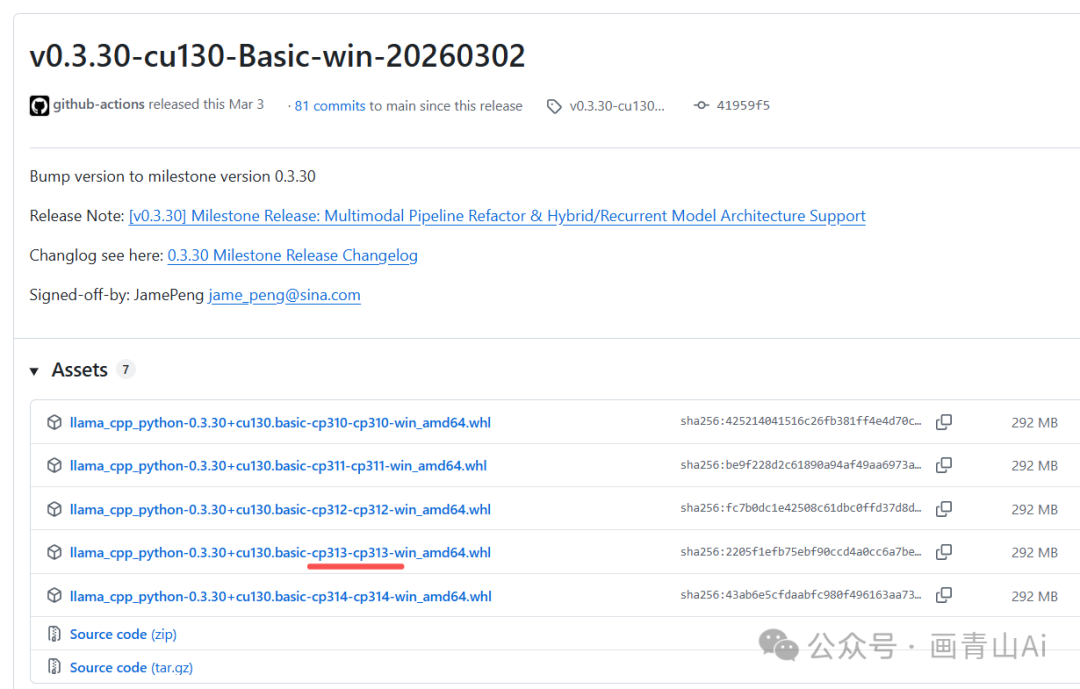

点击进入后,因为python版本是3.13.11,所以需要选择标有cp313的版本。

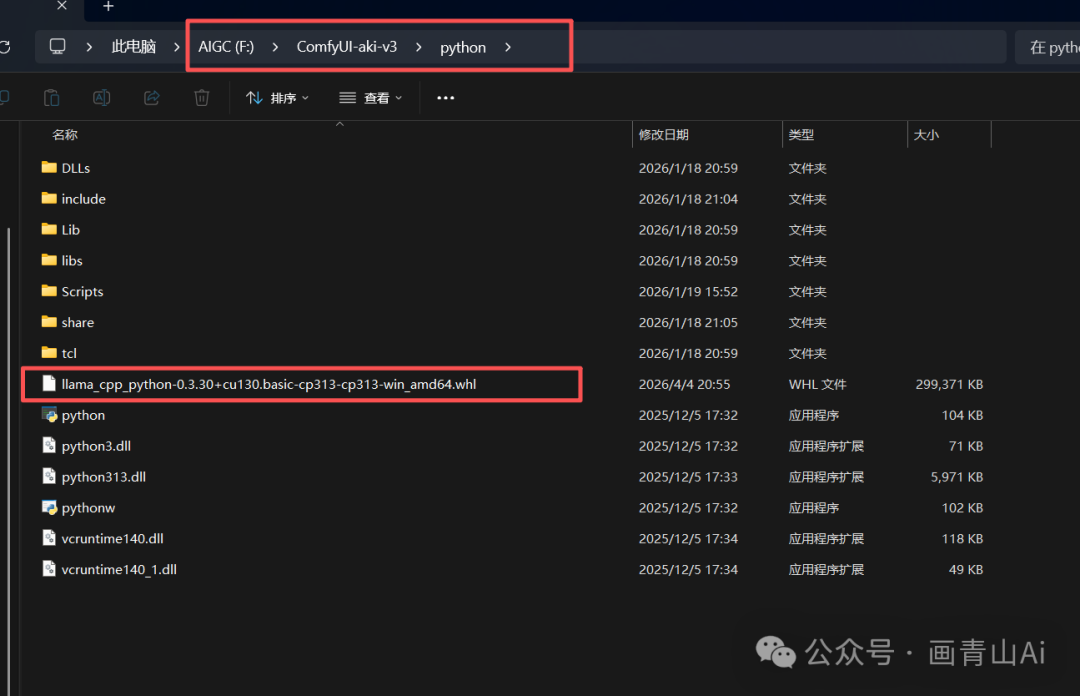

文件下载到comfyui安装目录的python目录下。

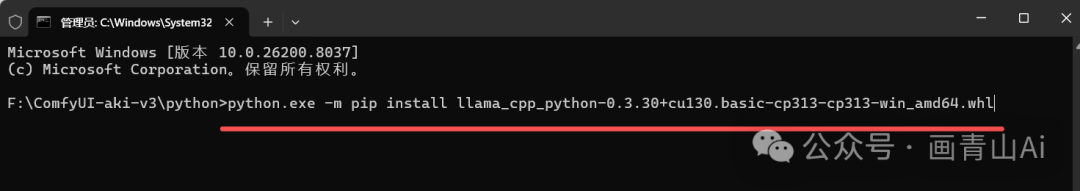

在python文件夹目录的地址栏输入cmd,命令行输入 python.exe -m pip install llama_cpp_python-0.3.30+cu130.basic-cp313-cp313-win_amd64.whl进行安装(注意此处仅为示例,轮子版本需改为个人所下载的版本型号)

4 模型安装

4.1 主模型安装

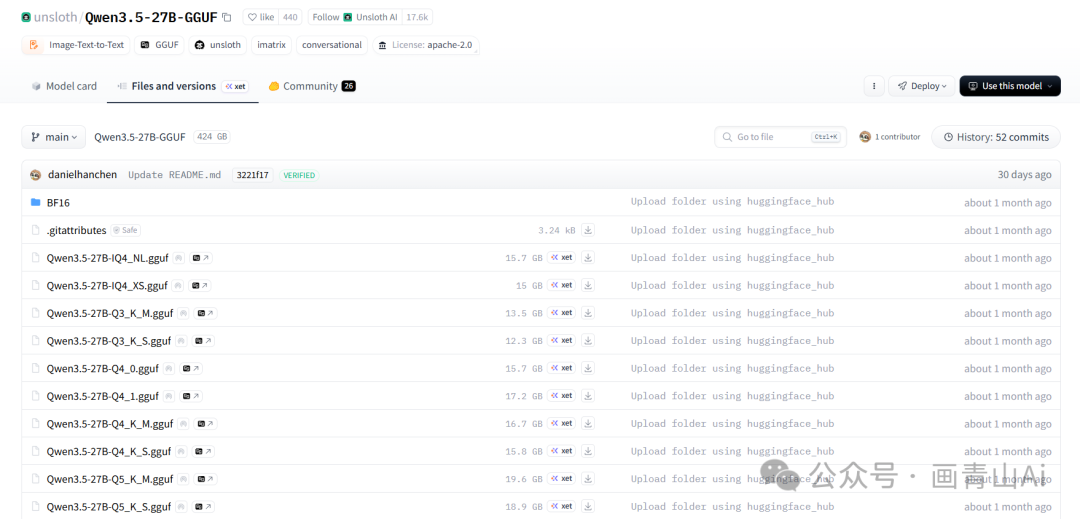

模型下载地址:https://huggingface.co/unsloth/Qwen3.5-27B-GGUF/tree/mainqwen3.5

模型体积很大,均为GGUF格式,具体版本型号根据电脑显存大小进行选择。如果选择最小的Q2版本,显存需求基本上就需要在12G左右。16G显存显卡,可选择Q3及以下版本。

模型下载安装地址为../ComfyUI/models/LLM

4.2 权重文件安装

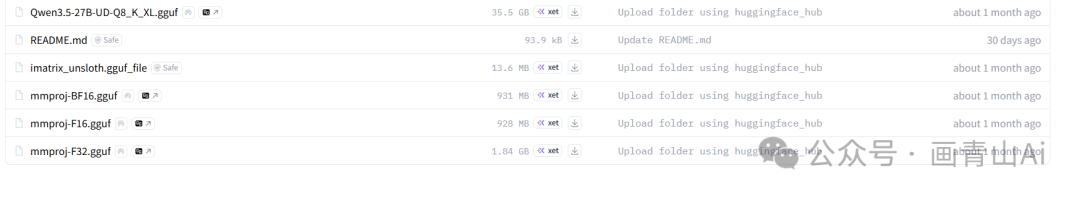

另外,为正常使用Qwen3.5模型顺利进行图像推理, 还需下载主模型对应的mmproj权重文件(在页面最下方)。

文件也是安装在../ComfyUI/models/LLM文件夹中。

下载地址

- 夸克网盘