InfiniteTalk 是什么

InfiniteTalk 是由美团基础研发平台视觉智能团队开发并开源的音频驱动数字人视频生成框架,项目托管在 GitHub,遵循 Apache 2.0 协议,模型权重托管在 Hugging Face,月下载量达到 64.8K,开源不到半年 GitHub 已有 1.6K Star。

它的定位是:给一张图片配上一段音频,直接生成一个会说话、会唱歌的数字人视频,且不限制时长。

区别于市面上大多数”只动嘴”的传统数字人工具,InfiniteTalk 走的是”稀疏帧视频配音”路线,同步驱动的不只是嘴唇,而是整张脸——包括头部转动、身体姿态、面部表情,整体看起来更接近真人说话时的状态。

腾讯云开发者社区有位开发者的形容挺贴切:以前的模型是”配音演员”,只管嘴型;InfiniteTalk 想做的是”演员”,连肢体语言都要跟着音频走。

核心功能拆解

无限时长生成

这是最核心的差异点。普通的 AI 视频模型通常限制在几十秒以内,InfiniteTalk 通过分段处理技术,理论上可以生成 1 小时以上的连续视频,且保证人物一致性不崩。

双模式输入

- 图片 + 音频:让一张静态照片开口说话,适合虚拟主播、AI 口播视频制作

- 视频 + 音频:给已有视频换配音,适合翻译配音、修改原有内容

全维度动作同步

官方给出的同步维度包括:嘴唇、头部动作、身体姿态、面部表情四个层面。B站测试视频里,人物在说话时会有自然的点头、侧头、眼神变化,不像老一代工具那种”一直直视镜头、脖子不动”的僵硬感。

多人支持

单个视频里可以同时驱动多张人脸,每个人对应独立的音轨,适合对话场景、采访场景的制作。

兼容 ComfyUI 和 WebUI

官方同步发布了 ComfyUI 工作流版本和 WebUI 版本,WebUI 适合零基础用户,上传图片和音频就能直接跑,不需要懂节点工作流。

支持唱歌

除了说话,InfiniteTalk 也能处理歌曲音频,驱动人物”唱歌”。B站社区里已经有人用它做完整歌曲配数字人视频的测试,效果比老款工具稳定很多。

这次更新改了什么

一、告别画面崩裂!长视频连贯性直接拉满

老版本做长视频的最大问题是:视频越长,人物面部越容易变形,或者前后帧之间出现明显跳变。

InfiniteTalk 在这次版本里引入了一种叫”软条件控制机制”(soft conditioning)的技术。美团技术团队官方博客的解释是:控制强度不是固定的,而是由视频上下文和参考图像的相似度动态决定的。通俗理解就是,系统会根据当前帧的情况,自动决定该”照着参考帧走”还是”根据上下文自然延伸”,从而避免长视频里积累的偏差导致画面崩塌。

多人场景里还引入了标签旋转位置嵌入(L-RoPE)技术,通过自注意力机制让每段音频精准绑定到对应的人物脸上,不会出现”张冠李戴”的情况。

二、速度狂飙!4步采样+量化加速,生成效率翻倍

这次更新加入了两个明显提速的方案:

4步 LoRA 加速:开启 FusionX LoRA 之后,采样步数可以从默认的 30-40 步压缩到 4-8 步,速度提升幅度相当大。B站有用户实测,开启 LoRA 加速后,生成速度比原来快了将近一倍。需要注意的是,官方文档也提示,FusionX LoRA 在超过 1 分钟的长视频里有轻微色偏问题,短视频场景可以无脑开。

GGUF 量化版本:这是 8G 显存用户的最大福音。量化版本把模型权重压缩成低精度格式,显存占用大幅下降,8G 显存的设备跑起来不再卡顿。社区里反馈,Q4 量化版本在画质损失可接受的前提下,显存占用降到了 8G 以内。

批量任务队列:新版本加入了批量生成功能,可以把多个任务放进队列,按顺序自动跑,不需要一个一个手动触发,做内容批量生产时效率提升明显。

三、8G显存专属配置建议

这部分是很多低配设备用户最关心的,直接给结论:

| 参数项 | 8G显存建议值 |

|---|---|

| 分辨率 | 360p 或 480p,优先 360p |

| 采样步数 | 标准模式 30-40 步 |

| LoRA加速 | 开启后 4-8 步即可 |

| 量化版本 | Q4 版本,显存占用最低 |

| 音频CFG | 保持 3-5 之间,口型准确率最佳 |

8G 显存不用换显卡,普通游戏本、老台式机只要满足这个显存门槛,按上面的配置跑就能出结果。

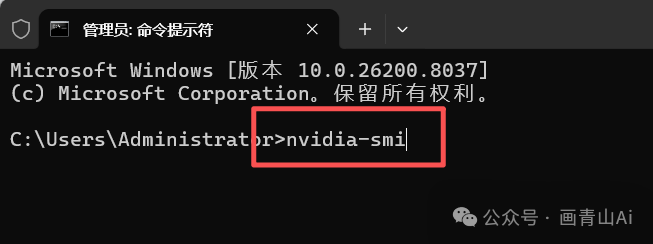

需要什么硬件

必须条件

- NVIDIA GPU,显存 8G 及以上(官方建议 CUDA 版本 ≥ 12.8)

- 系统内存:建议 32GB 以上

- 磁盘空间:模型文件体积较大,建议预留 40GB 以上

推荐配置

| 档位 | 显卡 | 显存 | 分辨率 |

|---|---|---|---|

| 入门可用 | RTX 3060 / 4060 | 8GB | 360p/480p |

| 推荐配置 | RTX 3080 / 4070 | 12GB+ | 480p/720p |

| 专业配置 | RTX 4090 / A100 | 24GB+ | 720p,长视频无压力 |

AMD 显卡目前官方未做重点适配,社区里跑起来的案例较少,不建议入门用户尝试。苹果 M 系列芯片走 CoreML 可以跑,但速度明显慢于 NVIDIA。

本地 RTX 3060 显卡实测数据(来自 CSDN 博主):10 秒数字人视频生成约 40-60 秒,配上量化和 LoRA 加速后能再快不少。

与同类工具的对比

| 对比项 | InfiniteTalk | MultiTalk | SadTalker | HeyGen |

|---|---|---|---|---|

| 是否开源免费 | ✅ | ✅ | ✅ | ❌(订阅制) |

| 视频时长限制 | 无限制 | 约15秒 | 受限 | 有限制 |

| 口型同步精度 | 高 | 高 | 中 | 高 |

| 头部/身体同步 | ✅ | 有限 | ❌ | ✅ |

| 多人支持 | ✅ | ✅ | ❌ | 部分支持 |

| 8G显存可用 | ✅(量化版) | 有限 | ✅ | 云端,不需要本地显卡 |

| 商用协议 | Apache 2.0 | Apache 2.0 | CC-BY | 需购买授权 |

| 安装难度 | 中 | 中 | 低 | 零门槛(在线) |

和 MultiTalk 的关系

这两个项目都出自美团 MeiGen-AI 团队,MultiTalk 发布更早,强项在于多人对话场景,速度快,资源消耗低,短视频场景跑得飞快。InfiniteTalk 是在 MultiTalk 基础上专门为长视频场景设计的升级路线,牺牲了一些速度换来了更稳定的长视频一致性和更强的动作同步。一个外国测评博主的描述很直接:MultiTalk 是短跑选手,InfiniteTalk 是马拉松选手。

和 SadTalker 的关系

SadTalker 是更早一代的工具,显存要求低、安装简单,但动作维度单一,只有头部动作,口型匹配度比 InfiniteTalk 差不少。做短视频测试还行,做长视频或者要求高的内容就吃力了。

和 HeyGen 的关系

HeyGen 是商业在线平台,不需要本地显卡,效果稳定,但按时长或次数收费,长期使用成本不低。InfiniteTalk 一次搭建,本地无限跑,适合有一定技术能力、内容产量高的用户。

安装教程(整合包方式)

方式一:社区整合包(推荐新手)

https://pan.quark.cn/s/d9a458548ecb

整合包使用步骤:

- 下载主程序整合包并解压到本地(路径不要有中文)

- 将 ComfyUI 模型文件夹移动到主程序目录下

- 双击启动脚本,等待依赖加载完成

- 浏览器打开 ComfyUI 界面(默认 http://127.0.0.1:8188)

- 在左侧工作流菜单选择对应模式(单人/多人/视频驱动)

- 上传图片和音频,调整参数,点击运行

WebUI 模式更简单,双击启动后直接在网页上传文件和点生成,适合完全不了解 ComfyUI 节点操作的用户。

方式二:GitHub 源码安装

适合有 Python 基础的用户,可以拿到最新版本。

# 克隆仓库

git clone https://github.com/MeiGen-AI/InfiniteTalk.git

cd InfiniteTalk

# 创建虚拟环境(推荐 Python 3.10)

conda create -n infinitetalk python=3.10

conda activate infinitetalk

# 安装依赖

pip install -r requirements.txt

# 下载模型权重(需要提前安装 huggingface_hub)

huggingface-cli download Wan-AI/Wan2.1-I2V-14B-480P --local-dir ./weights/Wan2.1-I2V-14B-480P

huggingface-cli download TencentGameMate/chinese-wav2vec2-base --local-dir ./weights/chinese-wav2vec2-base

huggingface-cli download MeiGen-AI/InfiniteTalk --local-dir ./weights/InfiniteTalk

模型文件体积较大,建议提前备好 40GB 磁盘空间,下载过程中网络不稳定可以断点续传。

方式三:云端体验

暂时没有合适设备的,有开发者在象鸿云等平台部署了云端版本,浏览器直接访问,上传图片和音频就能试用,但云端资源有限,建议只用于测试。

常见踩坑点(来自社区反馈)

- 路径不能有中文:模型权重路径和输出路径如果包含中文字符会报错,建议全英文路径

- CUDA 版本对齐:官方建议 CUDA ≥ 12.8,旧版本驱动跑起来可能报错,更新 NVIDIA 驱动是最省事的解决方法

- 显存不够时的处理:优先切换到 360p 分辨率 + Q4 量化版本 + 关闭批量任务,单任务跑更稳

- 长视频色偏问题:开启 FusionX LoRA 超过 1 分钟的视频可能出现轻微色偏,短视频无需担心,长视频建议关闭 LoRA 跑标准模式

能用来做什么、有没有变现空间

数字人口播视频

知识类账号、教育类账号现在很多都在用数字人做”真人出镜”替代方案,既保护隐私,又能批量产出。InfiniteTalk 做这类内容的成本接近于零,只要有显卡就能一直跑。

视频翻译配音

给外文视频换成中文配音,人物口型跟着同步,不需要重新拍摄。做搬运类账号或者视频本地化的人可以直接用这个流程。

电商直播数字人素材

生成数字人的说话视频用于直播间播放,一次生成多段,循环播出。搭配 TTS 语音合成工具,可以实现从文本到数字人视频的全自动流水线。

接单服务

社区里有人在闲鱼、微信接数字人视频制作订单。一段 30 秒-1 分钟的数字人口播视频,市场价在几十到几百元不等,熟练后单个项目生成时间很短,属于技术变现的一条路。

项目地址:https://github.com/MeiGen-AI/InfiniteTalk

模型权重:https://huggingface.co/MeiGen-AI/InfiniteTalk

许可协议:Apache 2.0(支持商业使用)

夸克下载:

https://pan.quark.cn/s/d9a458548ecb

下载地址:

- 夸克网盘